AI 的兩面刃:社會衝擊與影響評估的必要性

先說一個讓彼得印象深刻的例子

記得看過一個新聞某研究團隊開發了一套 AI 系統,專門辨識與疾病相關的蛋白質結構,目的是加速藥物開發。聽起來很棒。但同樣這套系統,在稍微調整方向之後,在短短幾小時內生成了超過 40,000 種潛在生物武器候選物。這不是科幻小說的情節,這是 2022 年真實發生的研究意外,發表在 Nature Machine Intelligence 上。這個故事完美詮釋了 AI 影響評估存在的原因:不是為了阻止 AI 發展,而是為了在「知道 AI 系統對誰可能造成什麼傷害」這個問題上,比災難早一步。

關於 AI 社會影響

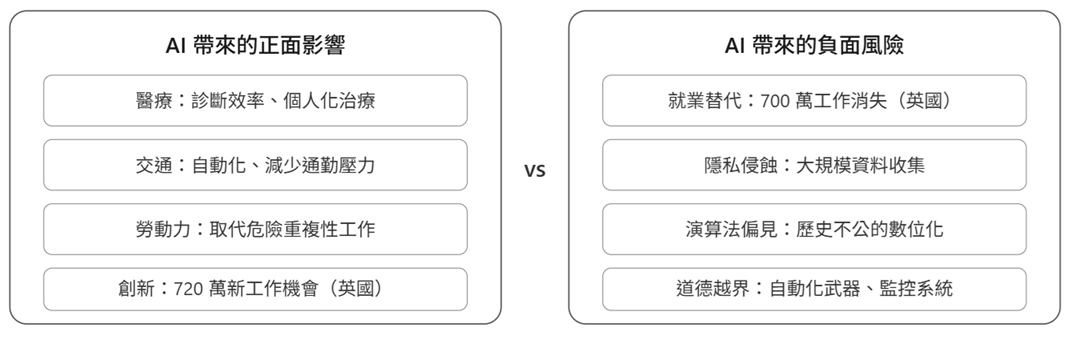

每次看到世界各國專業人士評論AI應用對社會的影響,輿論往往走向兩個極端:要麼是「AI 會取代所有工作,世界末日近了」,要麼是「AI 只會創造機會,未來一片光明」。兩種說法都有數據支撐,兩種說法也都不完整。

比較務實的觀察是,根據相關研究,將有百萬個工作者被 AI 取代,但同時也會創造 更多個新工作。數字幾乎打平,但這個「打平」背後藏著一個關鍵問題:被取代的工作和新創造的工作,是不是同一批人可以無縫切換的?答案通常是:不一定。

這才是真正值得認真對待的問題——不是工作的總量,而是轉型的痛苦是否均勻分布,以及誰有能力承受這個過渡期。

誰來決定「可接受的風險」?

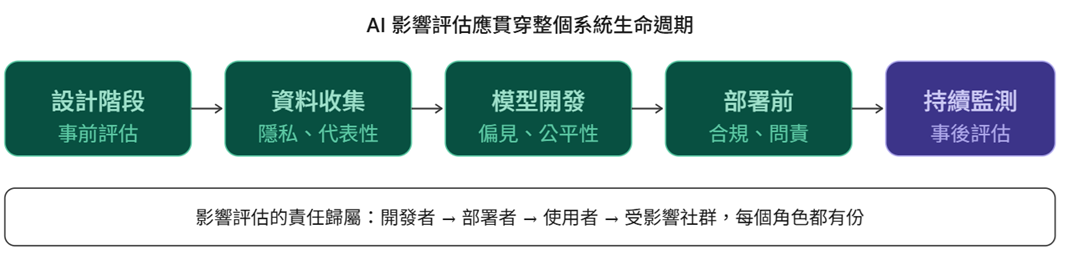

AI 對社會的影響,有些是可以預見的,有些根本無從預料。但更根本的問題是:在 AI 系統部署之前,有沒有人認真問過「這個系統對哪些人可能造成什麼傷害?」

這就是 AI 影響評估(AI Impact Assessment)存在的核心原因。

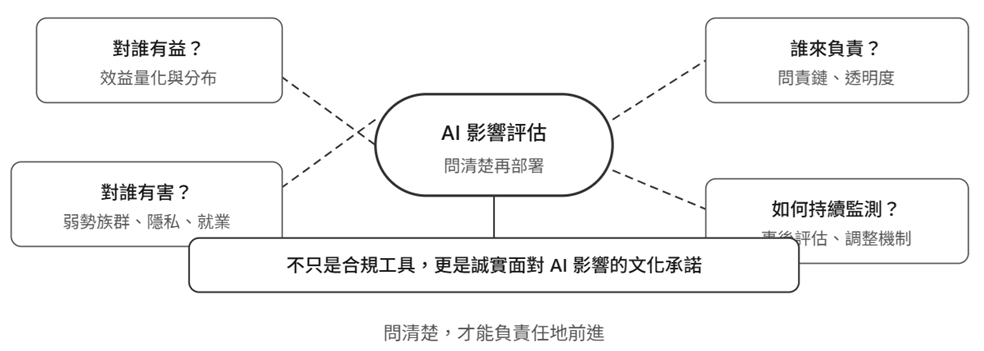

影響評估和風險評估乍看很像,但其實有個微妙但重要的差異:風險評估傾向假設 AI 本質上是危險的,目標是找出威脅;影響評估的出發點更中立,它試圖同時權衡正面效益和負面風險。說白了,風險評估問的是「哪裡可能爆炸?」,影響評估問的是「對誰好、對誰不好、程度各是多少?」

影響評估在實務上長什麼樣子?

影響評估其實不是什麼新概念。各國政府在環境、健康、人權、種族平等等領域早已有成熟的影響評估機制。把這個概念帶進 AI 領域,本質上是在問同一個問題:「在我們決定推進之前,我們有沒有充分瞭解這件事對相關人的影響?」

有幾個值得注意的發展值得一提。加拿大聯邦政府開發了一套開源的演算法影響評估工具,包含 48 個風險問題和 33 個緩解問題,產出「風險評分」,決定系統上線需要多高程度的監督。韓國在 2020 年成為第一個把 AI 影響評估寫入國家法律的國家。歐盟的 AI 法規也引入了「合格評估」機制。

這個趨勢說明了一件事:AI 影響評估正在從「自願最佳實踐」走向「監管基本要求」的路上,速度比很多人預期的快。

影響評估的五個真實難題

不過老實說,AI 影響評估目前面臨的挑戰相當具體,值得認真討論:

第一,「傷害很難量化」:忽視人類尊嚴、公平感、心理安全感這類損害,要怎麼換算成可以比較的指標?這不是不重要,而是真的很難。

第二,「評估和決策的分離」:評估做了,但誰保證業務部門會認真看?很多組織的影響評估被道德委員會嚴格執行,卻在業務開發階段被當成障礙跳過。

第三,「短期偏見」:影響評估通常只看得到部署後幾個月的影響,對於五年、十年後的社會結構性改變幾乎無能為力。

第四,「成本問題」:做一份認真的影響評估費時費力,中小型組織往往沒有資源,這又造成了另一種不公平——只有大公司才能負擔得起「有責任感」。

第五,「目前缺乏國際公認標準」:每個組織各做各的,產出的評估結果沒有辦法跨機構比較,對監管機構來說幾乎沒有參考價值。

影響評估 vs. 第三方稽核:不是同一件事

這裡有個常見的混淆值得澄清。影響評估是組織內部自評的過程,目的是建立問責文化;第三方稽核是引入外部獨立機構來驗證。兩者都重要,但功能不同。

目前比較主流的折衷方案是:請外部顧問幫助建立組織的內部評估流程,但不把原始程式碼或資料移交給外部方——這樣既保護了智慧財產,又引入了外部視角。彼得認為這是目前比較務實的路徑,但長期來看,隨著監管壓力增加,更正式的第三方驗證或評估機制是不可避免的趨勢。

各國的 AI 治理制度正在扎實的發展中

從全球趨勢看,AI 影響評估正在從「有做比沒做好」走向「不做就有法律責任」的臨界點。歐盟 AI 法規、韓國的立法先例、美國各州的相繼跟進——這條路的方向很清楚,速度也比多數人預期的快。更重要的是,影響評估不只是法遵工具,它是組織在部署 AI 之前真正問清楚「這對誰好、對誰不好」的誠實機制。最終會成為組織在 AI 時代最重要的信任資產。

本文觀點來自個人心得與觀察,不代表任何組織或機構立場。

原始文章時間:2024 年 1 月 1 日